مدونات

الخوارزميات والحرب.. مأزق أخلاقي في عصر الذكاء الاصطناعي!

الخوارزميات والحرب.. مأزق أخلاقي في عصر الذكاء الاصطناعي!

للكاتب: عبد الرحمن حسنيوي

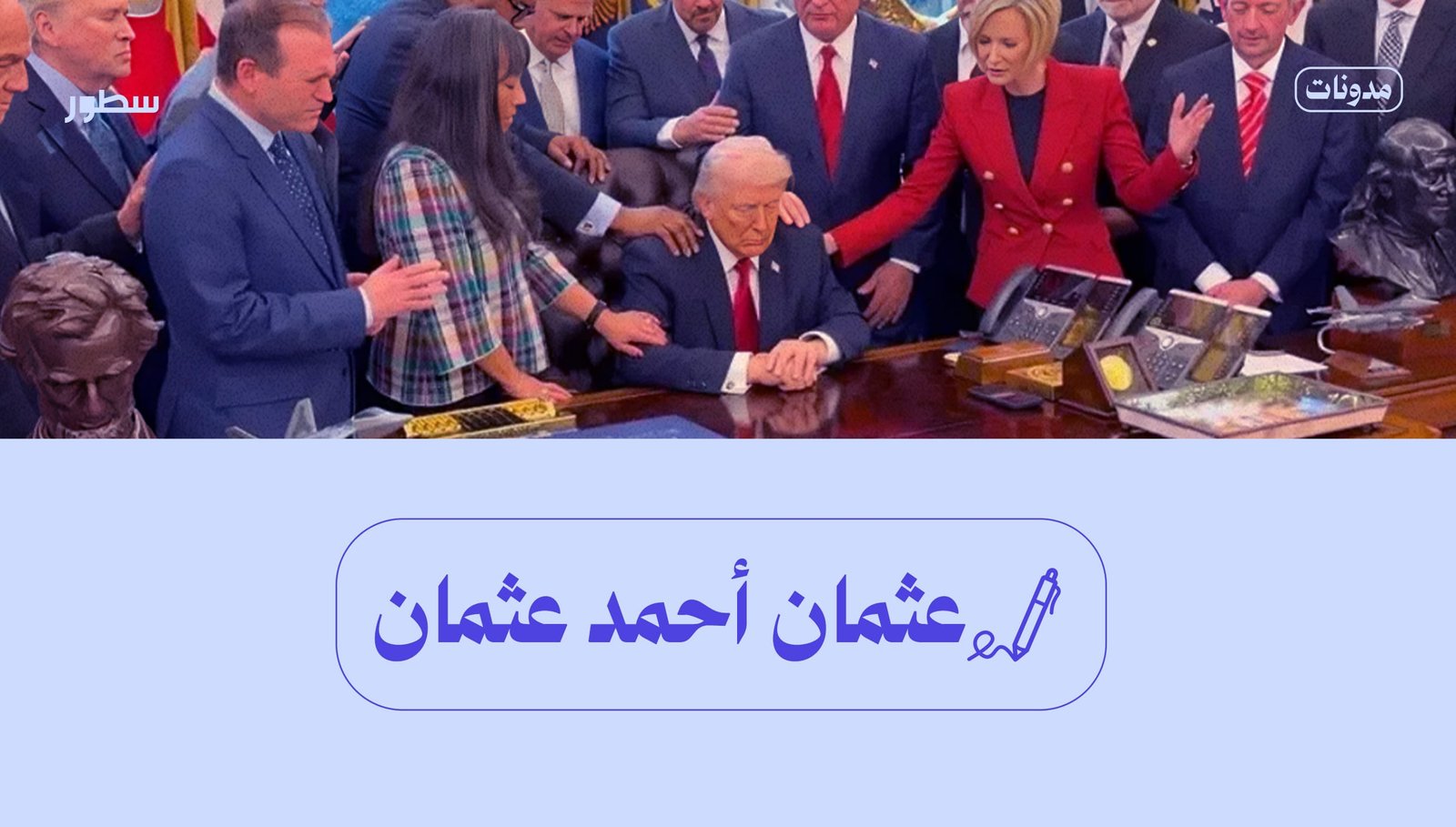

قالت المهندسة المغربية ابتهال أبو السعد لمديرها في مايكروسوفت خلال الاحتفال بمرور 50 عامًا على تأسيس الشركة: “تزعمون أنكم ملتزمون باستخدام الذكاء الاصطناعي للخير، لكن الحقيقة أن مايكروسوفت تبيع أسلحة الذكاء الاصطناعي للجيش الإسرائيلي.. خمسون ألف شخص فقدوا حياتهم في غزة، ومايكروسوفت تدعم هذه الإبادة الجماعية في منطقتنا”.

في عصرٍ تتسارع فيه الابتكارات التقنية بوتيرة لم يشهدها التاريخ من قبل، أصبحت الخوارزميات والذكاء الاصطناعي جزءًا لا يتجزأ من حياتنا اليومية، من التوصيات التي نتلقاها على منصات التواصل الاجتماعي إلى تطبيقات الصحة وتحليل البيانات… فهذه التقنيات تُسهم في تشكيل المستقبل، لكن خلف هذا التقدم المذهل يكمن مأزق أخلاقي خطير، يجعلنا نطرح السؤال التالي: كيف يمكن أن تتحول هذه الأدوات، المصممة لتحسين حياة البشر، إلى أسلحة قمعية تُستخدم في الحروب والصراعات “تجارة الموت”؟

مما لا شك فيه أن الذكاء الاصطناعي يحمل إمكانيات هائلة لتحسين الحياة، من التنبؤ بالكوارث الطبيعية إلى تحسين نظم الرعاية الصحية والتعليم… كما يُمكن لهذه التكنولوجيا أن تُحدث ثورة إيجابية في العالم، لكن الوجه الآخر للعملة يظهر “وحشية الخوارزميات” عندما تُسخَّر هذه الإمكانيات لتحقيق أهداف عسكرية أو سياسية تخدم مصالح فئة على حساب أخرى.

أحد الأمثلة البارزة على ذلك هو ما كشفت عنه المهندسة المغربية ابتهال أبو السعد في احتجاجها الشجاع على تورط شركة مايكروسوفت في دعم الجيش الإسرائيلي. كان ذلك خلال حفل بمناسبة الذكرى الخمسين لتأسيس الشركة، حيث وقفت ابتهال لتندد بتسخير أدوات الذكاء الاصطناعي الخاصة بالشركة في مراقبة الفلسطينيين واستهدافهم، وأشارت إلى أن الشركة وقعت عقودًا بملايين الدولارات مع جيش الاحتلال الإسرائيلي لتطوير تقنيات تُستخدم في العمليات العسكرية تستهدف الأطفال والنساء والشيوخ الأبرياء.

هذا الكشف يثير تساؤلات أخلاقية عميقة حول دور شركات التكنولوجيا الكبرى: كيف يمكن لهذه الشركات، التي تدّعي الالتزام بمبادئ “الذكاء الاصطناعي من أجل الخير ومستقبل أفضل للإنسانية!”، أن تبرر تورطها في الصراعات العسكرية؟ في حالة مايكروسوفت، تم استخدام خدمات “مايكروسوفت أزور Microsoft Azure” السحابية لتخزين وتحليل بيانات ضخمة تُستخدم في مراقبة الفلسطينيين وتعزيز بنك الأهداف الإسرائيلي. يُظهر هذا بوضوح كيف يمكن للخوارزميات أن تصبح أدوات للقمع بدلاً من التقدم.

ما يفاقم الأزمة هو أن هذه الشركات ليست مُجبرة قانونيًا على التوقف عن هذه الممارسات، فلا توجد حتى الآن معاهدات دولية تُنظم استخدام الذكاء الاصطناعي في الحروب، كما هو الحال مع الأسلحة البيولوجية والكيميائية والنووية… هذا الفراغ القانوني والتشريعي يسمح للشركات بالعمل بحرية، متجاهلةً الأضرار الإنسانية التي قد تسببها.

لكن المسؤولية لا تقع فقط على عاتق الشركات، فالمهندسون والمبرمجون العاملون في هذه المؤسسات يلعبون دورًا مهمًا في هذه الديناميكية، ما يجعلنا نطرح الإشكاليات التالية: هل يمكنهم أن يظلوا صامتين إزاء استخدام تقنياتهم في قتل الأبرياء؟ أم أن لديهم مسؤولية أخلاقية للوقوف ضد هذه الممارسات؟ ما فعلته ابتهال أبو السعد يوضح أن الصوت الفردي يمكن أن يكون مؤثرًا، لكن السؤال الأهم هو: كم من الأشخاص داخل هذه الشركات مستعدون لرفع أصواتهم؟

المشكلة تتجاوز الأفراد والشركات لتصل إلى صلب الهيكل الاقتصادي العالمي، ففي ظل نظام رأسمالي يضع الأرباح فوق كل اعتبار، تبدو الأخلاق أحيانًا كترف لا تستطيع الشركات تحمل تكلفته، لأن العقود المربحة مع المؤسسات العسكرية تضمن تدفق الأرباح، بغض النظر عن التبعات الإنسانية. لكن، هل يمكن أن نستمر في تجاهل هذه التبعات؟ إذا كنا نعتبر استخدام الأسلحة الكيماوية والبيولوجية جرائم ضد الإنسانية، أليس من المنطقي أن نضع استخدام الذكاء الاصطناعي في الحروب ضمن نفس الإطار؟

الحاجة إلى قوانين ومعايير دولية لتنظيم هذه التكنولوجيا أصبحت أكثر إلحاحًا من أي وقت مضى، فالذكاء الاصطناعي هو أداة مثله مثل القلم والكتاب… وما يُحدد تأثيره هو الغرض الذي يُستخدم من أجله، حيث يمكن أن يكون وسيلة لتحسين حياة الناس، كما يمكن أن يتحول إلى سلاح بيد القوي لقهر الضعيف. لكن المسؤولية هنا تقع على الجميع: الشركات، المهندسين، الحكومات، والمجتمع الدولي.

في الأخير، ما فعلته ابتهال أبو السعد هو دعوة للاستيقاظ، فقد ذكّرتنا بأن التكنولوجيا ليست محايدة، وأن الطريقة التي نستخدم بها الذكاء الاصطناعي اليوم ستُحدد مستقبلنا. إذا اخترنا الاستمرار في هذا المسار الذي يجعل من الخوارزميات أدوات للقمع وآلة للقتل، فإننا نخاطر بفقدان أحد أعظم إنجازات البشرية. لكن إذا قررنا مواجهة هذه التحديات الأخلاقية بشجاعة، يمكننا أن نعيد توجيه الذكاء الاصطناعي ليصبح قوة للخير والسلام، بدلاً من أن يكون مشاركًا في تدمير الإنسانية.